AI buduje grę multi

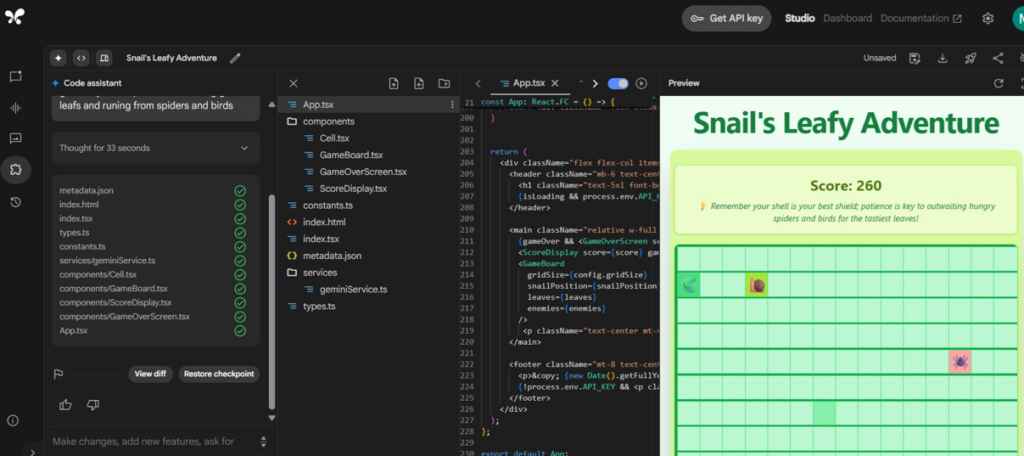

Sztuczna inteligencja, a w szczególności zaawansowane modele językowe (LLM), otwierają drzwi do świata technologii osobom, które dotychczas nie miały doświadczenia w programowaniu. Dziś bariera wejścia drastycznie zmalała, umożliwiając laikom projektowanie własnych, funkcjonalnych aplikacji i gier. Na rynku istnieją już gotowe studia, takie jak Google AI Studio, które oferują kompleksowe środowisko: prowadzą użytkownika krok po kroku przez proces twórczy, a nawet zapewniają miejsce na serwerze, zdejmując z barków twórcy ciężar konfiguracji infrastruktury.

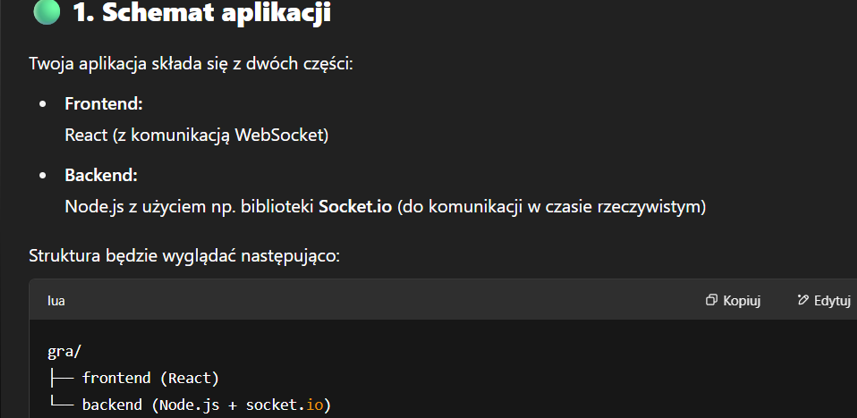

Niestety, szybko okazuje się, że gotowe rozwiązania generowane z „jednego promptu” mają swoje ograniczenia. Choć potrafią zachwycić piękną grafiką, często nie oferują grywalności, na jakiej nam zależy. Dodatkowo, aby naprawdę zrozumieć, jak to wszystko działa, warto przejść proces ręcznie, krok po kroku. W tym scenariuszu zakładamy, że posiadamy własny serwer z podpiętą domeną (czyli totalną bazę). Pracę rozpoczynamy od poproszenia AI o zaproponowanie struktury aplikacji webowej. W odpowiedzi otrzymujemy jasny podział na Backend i Frontend wraz z propozycją konkretnych technologii, które najlepiej sprawdzą się w naszym projekcie.

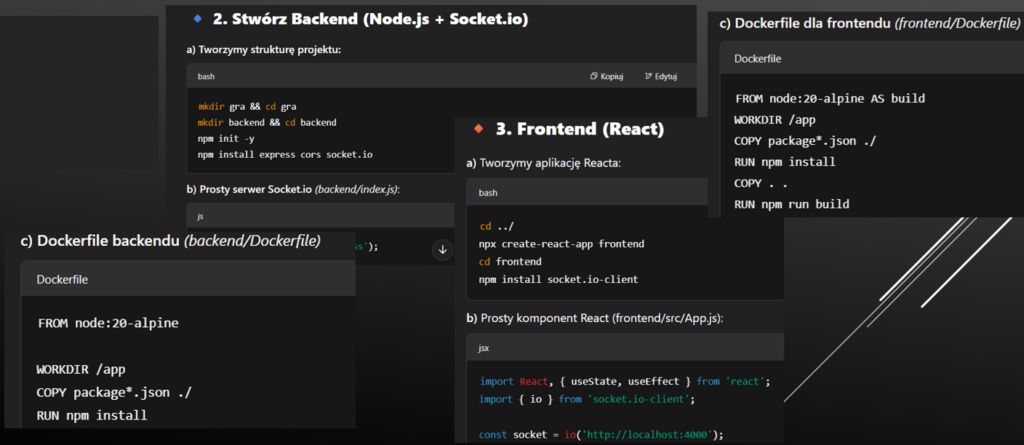

W tym momencie zatrudniamy naszego głównego projektanta – sztuczną inteligencję – do implementacji pomysłów. Nasz dzielny, wirtualny programista prowadzi nas za rękę, dzięki czemu szybko możemy uruchamiać n-tą iterację naszego projektu. Aby zachować profesjonalizm, rozwiązanie opieramy na nowoczesnym stacku technologicznym: React, Node.js oraz Docker. Mamy więc wszystko, co niezbędne: aplikację w przeglądarce, logikę na serwerze oraz zarządzanie środowiskiem poprzez kontenery. Kolejne iteracje to nie tylko rozwój gry, ale także świetna lekcja tego, co dzieje się „pod maską” (nawet jeśli kod czasami nie jest w 100% optymalny – no cóż, nikt nie jest doskonały ;)).

Skoro mamy już działający kod, czas zająć się warstwą wizualną. Większość nowoczesnych czatów AI umożliwia generowanie grafik. Wystarczy sprecyzować, czego oczekujemy i jakie elementy gry (assets) powinny się pojawić na ekranie. Po kilku próbach i doprecyzowaniu opisów otrzymujemy zestaw potrzebnych grafik, które idealnie wpisują się w klimat naszej produkcji.

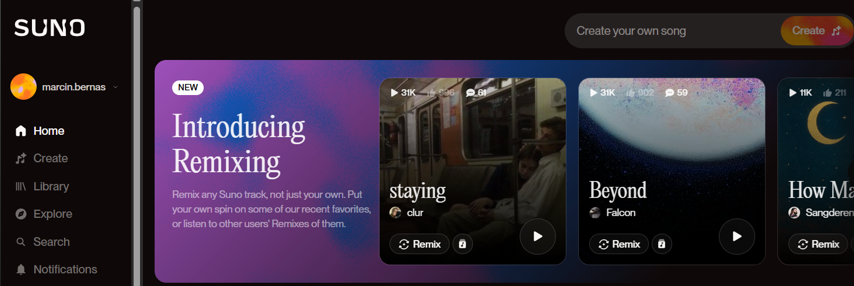

Ostatnim, ale kluczowym elementem budującym klimat, jest dźwięk. Każda gra wymaga odpowiedniego podkładu. W tym przypadku część efektów dźwiękowych (SFX) wyszukujemy w internecie – tutaj AI również służy pomocą, wskazując bazy z darmowymi zasobami. Ja wykorzystałem [110,000+ Free Sound Effects for Download – Pixabay]. Natomiast podkład muzyczny to już zasługa generatywnego AI (np. Suno). W moim przypadku okazało się, że muzyka w stylu Country dla małego ślimaczka to absolutny ideał.

Rozwój projektu to proces ciągły. Na koniec, po wielu iteracjach, kodowaniu i generowaniu zasobów, można wreszcie zagrać. Każda kolejna rozgrywka dostarcza nowych danych i pomysłów na to, co można poprawić lub rozbudować.

Zapraszam do testów (najlepiej w grupie): 👉 chwilowo gra wyłączona